國際權威期刊《科學》(Science)雜志發表了一篇由來自全球多國的25位世界頂尖人工智能、計算機科學、公共政策及倫理學領域的科學家聯合署名的評論文章。文章的核心議題是呼吁國際社會采取比當前“更強有力、更系統化”的集體行動,以應對人工智能(AI)技術快速發展所帶來的日益嚴峻的潛在風險,并著重提出了建設“人工智能公共數據平臺”這一關鍵性倡議。

文章開篇即指出,人工智能,尤其是大型語言模型和生成式AI的爆炸式發展,在帶來生產力革命、科學發現加速和社會福祉提升的巨大機遇的也伴隨著一系列深刻且可能不可逆的風險。這些風險不僅限于技術層面,更廣泛涉及社會倫理、經濟結構、地緣政治乃至人類文明的長期未來。科學家們列舉的風險圖譜包括但不限于:

- 系統性風險與失控:高級AI系統可能因其目標的復雜性和不可預測性,產生與人類價值觀相悖甚至有害的行為,尤其是在自主決策系統中,存在“對齊問題”未能徹底解決而導致的失控風險。

- 社會公平與偏見加劇:當前AI模型的訓練嚴重依賴互聯網等來源的數據,其中蘊含的社會偏見、歷史不公和虛假信息可能被放大和固化,進一步加劇社會不平等和歧視。

- 安全與惡意濫用:AI能力可能被用于開發新型網絡武器、制造高度逼真的虛假信息(如深度偽造)進行輿論操縱、或輔助自動化攻擊系統,對國家安全和個人隱私構成嚴重威脅。

- 經濟顛覆與就業沖擊:AI自動化可能以空前的速度和廣度取代人力,引發大規模結構性失業和社會動蕩,而由此產生的財富可能進一步集中。

- 生態與資源挑戰:訓練和運行尖端AI模型需要巨大的計算資源和能源消耗,其碳足跡對環境可持續性構成挑戰。

科學家們認為,目前各國政府、產業界和國際組織采取的措施——如自愿性的倫理準則、行業自律和零散的監管提案——在應對上述系統性、全球性挑戰方面顯得“碎片化且力度不足”。他們強調,AI風險的本質是跨國界的,任何單一國家或公司的行動都難以奏效,必須依靠全球性的協調與合作。

為此,聯名文章的核心建議是倡議并推動建立“人工智能公共數據平臺”。這一平臺構想具有以下關鍵特征與目標:

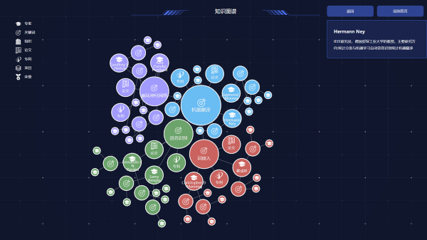

- 開放與協作的研究基礎設施:平臺旨在成為一個全球科學家、工程師和倫理學家可以安全、可控地訪問高質量、多樣化數據集和標準化計算資源的公共空間。其核心是打破目前高質量訓練數據被少數大型科技公司壟斷的局面,促進更廣泛、更透明的AI安全與對齊研究。

- 專注于安全與對齊研究:平臺將優先支持對AI系統安全性、魯棒性、可解釋性和價值觀對齊(Alignment)的研究。例如,研究人員可以在平臺上系統地測試AI模型在極端或對抗性情境下的行為,開發更有效的“紅隊測試”方法,以及探索讓AI系統穩定遵循復雜人類倫理框架的技術路徑。

- 標準化的風險評估基準:通過平臺,國際社會可以共同開發和維護一套權威、動態更新的AI風險評估基準與測試標準。這將為客觀衡量不同AI模型的風險水平、比較不同安全技術的有效性提供共同標尺,也為監管政策的制定提供科學依據。

- 促進全球治理與監管合作:該平臺的建設和運營本身可以成為國際AI治理合作的典范。它需要建立包括政府、學術界、產業界和民間社會代表在內的多邊治理架構,制定嚴格的數據安全、訪問權限和研究成果共享協議,為未來更廣泛的國際AI治理條約或框架奠定實踐基礎。

科學家們在文章中承認,建立這樣一個全球性平臺面臨政治意愿協調、資金籌集、技術實現、數據隱私保護以及防止技術被濫用的多重挑戰。但他們強調,與無所作為可能帶來的災難性風險相比,投入資源建設這樣的“全球公共品”是必要且緊迫的投資。

這25位頂尖科學家向全球的研究機構、國家政府、科技企業和公民社會發出強烈呼吁:必須立即提升AI風險防范的政治與資源優先級。他們敦促二十國集團(G20)、聯合國等主要多邊論壇將建立“人工智能公共數據平臺”及相關治理框架列入核心議程,并啟動實質性的籌備工作。他們認為,在AI能力可能超越人類智能關鍵閾值的“臨界點”到來之前,人類社會必須建立起有效監督和引導這一強大技術的集體能力。此次聯名發聲,標志著科學共同體對AI治理的關切已達到一個新的高度,也為全球應對AI時代的共同挑戰指明了一條以開放科學和國際合作為基礎的前進道路。